Deep Fakes | అనగనగా ఒక రాక్షసుడు. మారురూపాల్లో తిరుగుతుంటాడు. తను ఎక్కడున్నాడు? ఏ క్షణంలో దాడి చేస్తాడు? అన్నది ఎడతెగని సమస్య. అనగనగా ఓ దేవుడు. పట్టపగలు తప్పు చేస్తూ ‘కనిపించాడు’. తప్పు చేసింది తను కాదని మొత్తుకున్నాడు కానీ, ఎవరూ నమ్మలేదు. పురాణేతిహాసాల్లో, జానపద కథల్లో ఇలాంటి సందర్భాలు చాలానే కనిపిస్తాయి. ఇప్పుడు అవన్నీ నిజం అవుతున్నాయి. ఎలాంటి ఊహనైనా సాంకేతికత నిజం చేయగలదు. మానవాభివృద్ధిలో అదో పరిణామం. ఇప్పుడు ‘డీప్ ఫేకింగ్’ పేరుతో చలామణి అవుతున్న టెక్నాలజీ కూడా అలాంటిదే! మొదట్లో సరదాగా కనిపించి, తర్వాత సంచలనంగా మారి.. ఇప్పుడు సవాలు విసురుతున్నది.

ఫొటోగ్రఫీని కనిపెట్టి రెండువందల సంవత్సరాలు అవుతున్నది. జోసెఫ్ నిసెఫోర్ నిప్సె అనే ఫ్రెంచ్ పరిశోధకుడు 1825లో తొలిసారి ఫొటోను ప్రింట్ చేశాడని చెబుతారు. వెంటనే ఆ ఫొటోలను అవసరాలకు అనుగుణంగా మార్చుకునే ప్రయత్నాలు మొదలైపోయాయి. నెగెటివ్ను కత్తిరించి, డబుల్ ఎక్స్పోజ్ చేసి, గీతలు గీసి.. రకరకాలుగా మార్ఫింగ్ చేసేవాళ్లు. నాజీ ప్రచారకర్త గోబెల్స్ కూడా ఈ మార్గాన్ని అనుసరించినవాడే! కానీ జాగ్రత్తగా పరిశీలిస్తే, ఆ బండారం తేలిపోయేది. అంతలోనే వీడియోలు వచ్చాయి. ఇక మార్ఫింగ్ అసాధ్యమనే అనుకున్నారు. కానీ ‘డీప్ ఫేకింగ్’ దాన్ని సాధ్యం చేసింది. ముఖ కవళికలు, గొంతుతో సహా నూరుపాళ్లు నిజమే అనేంత భ్రమింపచేస్తున్నది. పుతిన్ అమెరికాను బెదిరిస్తున్నట్టు కనిపించినా, ఒబామాను ఖైదీలా చూపించినా… అవన్నీ వాస్తవమే అన్నంత నమ్మకంగా ఉంటున్నాయి.

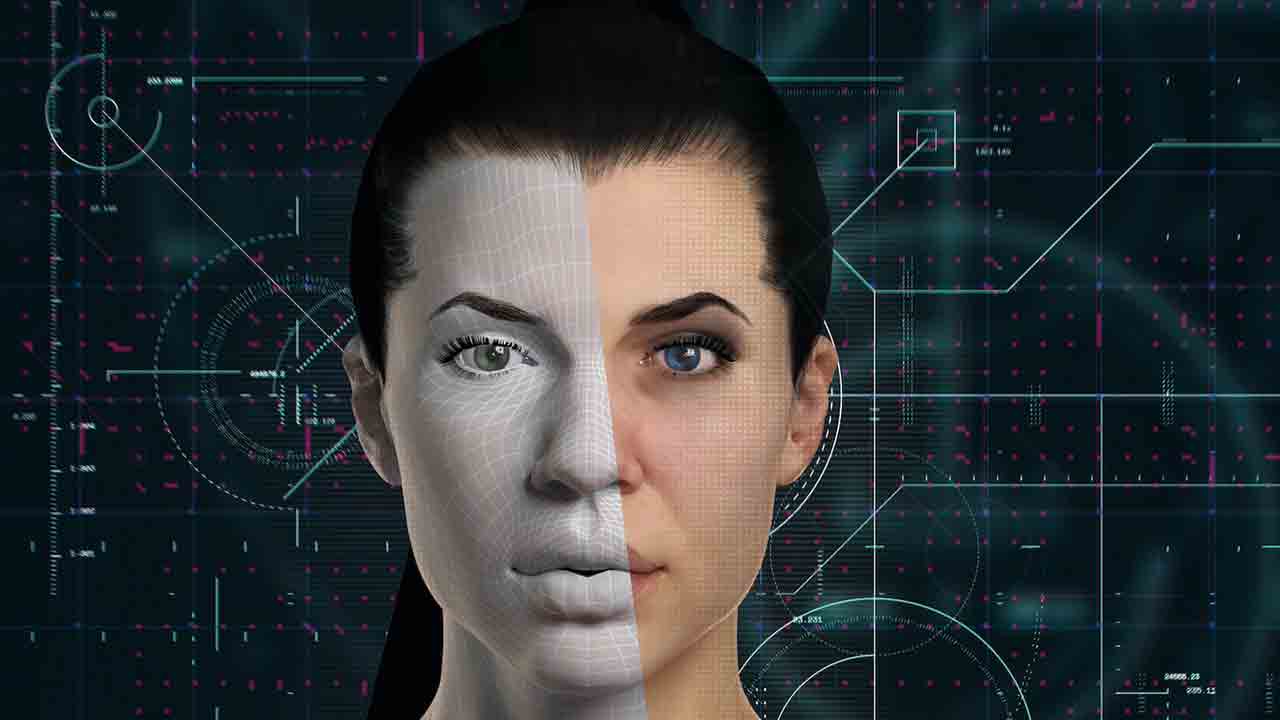

డీప్ ఫేకింగ్లో కృత్రిమ మేధస్సు (ఏఐ) పాత్ర కీలకం. కాబట్టే, తన ముందుంచిన సవాలును అర్థం చేసుకుని (అల్గారిథమ్స్ ద్వారా), ఈ సమస్యకు తానే పరిష్కారాన్ని కనుగొనే ప్రయత్నం చేస్తుంది.. ఆర్టిఫీషియల్ ఇంటెలిజెన్స్. డీప్ ఫేకింగ్ కోసం ఎన్కోడర్స్, డీకోడర్స్ సాంకేతికతను ఉపయోగిస్తారు. ఎన్కోడర్స్ రెండు చిత్రాల కదలికలను క్షుణ్నంగా పరిశీలించి, వాటి మధ్య సారూప్యతను పసిగడుతుంది. ఇక డీకోడర్స్ ముఖాలను మార్చేస్తుంది. ఇంతచేసినా కొంత లోటు ఉంటుంది. చూసే కళ్లకు అది డీప్ ఫేకింగ్ ఏమో అన్న అనుమానం వచ్చేస్తుంది. అందుకే Generative Adversarial Network అనే మరో సాంకేతికతను సంధించి.. డీప్ ఫేక్ వీడియోను మరింత సహజంగా మార్చేస్తున్నారు.

డీప్ ఫేక్తో ఫలానా సమస్యే వస్తుందని చెప్పడానికి వీల్లేదు. ఇది ఓ నకిలీ సామ్రాజ్యం. తారలు లేకుండానే వాళ్ల సినిమాలు రూపొందించవచ్చు. అమాయకుల్ని నేరాల్లో ఇరికించవచ్చు. ఎవర్నయినా బ్లాక్ మెయిల్ చేయవచ్చు. కళల నుంచి ప్రకటనల వరకు ఎవరి నకలునైనా నిజమే అన్నంత భ్రమ కల్పించవచ్చు. అంతదాకా ఎందుకు, సీటీ స్కాన్లను సైతం డీప్ ఫేక్ ద్వారా మార్చేయవచ్చని ఈమధ్యే జరిగిన ఓ పరిశోధన నిరూపించింది. ఇంకేముంది, మెడికల్ మాఫియా.. లేని అనారోగ్యం ఉన్నట్లుగా చూపించగలదు. హ్యాకర్లు కీలకరికార్డులను చెరిపేయగలరు.

2017 స్టార్ వార్స్ సిరీస్లో నటించిన ఓ ప్రముఖ నటి పోర్న్ వీడియోలను రెడిట్ వెబ్సైట్లో చూసి జనం ఆశ్చర్యపోయారు. అది డీప్ ఫేక్ వీడియో అని తర్వాత తెలిసింది. ఇప్పటికీ ఈ డీప్ ఫేక్ ప్రక్రియ, పోర్న్ రంగంలోనే ఎక్కువగా కనిపిస్తున్నది. 2019లో జరిగిన ఓ పరిశోధనలో… ఆన్లైన్లో కనిపించే డీప్ ఫేక్ వీడియోల్లో 96 శాతం పోర్న్ వీడియోలే అని తేలింది. వాటికి ఉండే డిమాండ్ మాత్రమే ఇందుకు కారణం కాదు. సెలెబ్రిటీలు, మరీ ముఖ్యంగా నటులకు సంబంధించిన వీడియోలు విస్తృతంగా అందుబాటులో ఉంటాయి. ఓ వ్యక్తికి సంబంధించి ఎన్ని చిత్రాలు అందుబాటులో ఉంటే.. డీప్ ఫేక్ ప్రక్రియ అంత తేలిక అవుతుంది. ఇలాంటి అనైతిక వీడియోలను అనుమతించం అంటూ పోర్న్హబ్ లాంటి సంస్థలు ప్రకటించినా, పరిస్థితిలో పెద్దగా మార్పు లేదు. పైగా రివెంజ్ పోర్న్ అనే సూత్రానికి కూడా ఈ డీప్ ఫేక్ తోడవుతున్నది. పగ తీర్చుకోవాలనుకునే వారికి సంబంధించిన వ్యక్తిగత చిత్రాలను బజారున పెట్టడమే.. రివెంజ్ పోర్న్. వ్యక్తిగత చిత్రాలు లేకపోయినా సరే.. డీప్ ఫేక్ సాయంతో పోర్న్ సృష్టించవచ్చు. నగ్న చిత్రాలు రూపొందించేందుకు ప్రత్యేక యాప్స్ సిద్ధంగా ఉన్నాయి. ఒక్క క్లిక్ చాలు.. జీవితాలతో ఆడుకోవచ్చు.

2019లో ఇంగ్లండ్కు చెందిన ఒక ఉద్యోగికి ఫోన్ వచ్చింది. అవతలివైపు జర్మనీ నుంచి బాస్ మాట్లాడుతున్నాడు. ఒక పంపిణీదారుడికి వెంటనే మూడుకోట్ల రూపాయలు పంపమని ఆదేశించాడు. వెంటనే ఉద్యోగి ఆ నగదును బదిలీ చేసేశాడు. మరో లావాదేవీ కోసం.. ఇంకోసారి ఫోన్ వచ్చేసరికి ఎందుకో అనుమానం వచ్చింది. తను మోసపోయానని గ్రహించాడు. ‘ఆ గొంతులో జర్మన్ యాస, మాట తీరు, మార్దవం… అచ్చం రోజూ నేను మాట్లాడే బాస్లాగే ఉంది’ అని వాపోయాడు ఆ ఉద్యోగి. గొంతును మాత్రమే అనుకరించగలిగే ఈ ప్రక్రియకు ‘ఆడియో డీప్ ఫేక్’ అని పేరు. ఇక దీనికి వీడియో కూడా జోడిస్తే చెప్పేదేముంది. ఇది ఆర్థిక మోసాలకే పరిమితం కాదు. బెదిరించో, భయపెట్టో ఎదుటి వారితో ఎలాంటి పని అయినా చేయించుకునే ప్రమాదాన్ని కలిగిస్తుంది.

ఆ మధ్య జరిగిన అమెరికా అధ్యక్ష ఎన్నికల్లో…జో బైడెన్ అవాకులు చెవాకులు పేలినట్టు డీప్ ఫేక్ వీడియోలు వచ్చాయి. గత రెండు సంవత్సరాల్లో, ప్రత్యర్థులను రాజకీయంగా దెబ్బతీసే విషయంలో ఇలాంటి వీడియోలు చాలానే ట్రెండ్ అయ్యాయి. ఎంతోకొంత ప్రభావం చూపాయి కూడా. డీప్ ఫేక్ను నేతలు తమ స్వలాభం కోసం వాడుకున్న సందర్భాలూ ఉన్నాయి. 2020 ఢిల్లీ అసెంబ్లీ ఎన్నికల్లో, స్థానిక భాషలో మాట్లాడిన ఓ అభ్యర్థి ప్రసంగాన్ని ఇంగ్లిషులో చూపేందుకు డీప్ ఫేక్ టెక్నాలజీనే వాడారు.

> కాస్త జాగ్రత్తగా గమనిస్తే కొన్ని డీప్ ఫేక్లను కనిపెట్టడం పెద్ద కష్టమేం కాదు.

> డీప్ ఫేక్ వీడియోల్లో కళ్లార్పడం కాస్త అసహజంగా ఉంటుంది. అసలు ఆర్పకుండానో, అతిగా ఆర్పినట్టో కనిపిస్తాయి.

> చుట్టూ ఉన్న వాతావరణంతో పోలిస్తే, మొహం కాంతివిహీనంగా కనిపిస్తుంది.

> మూలంలో ఉన్న వీడియోలోని వెలుతురునే డీప్ ఫేక్ సాంకేతికత తీసుకుంటుంది. అందులో మరో వ్యక్తి శరీరాన్ని చేర్చినప్పుడు… వెలుతురులో వ్యత్యాసం కనిపించవచ్చు.

> వీడియోను మహా నైపుణ్యంగా డీప్ ఫేక్ చేసినవాళ్లు, ఆడియో విషయంలో జాగ్రత్తపడకపోవచ్చు. దాంతో దృశ్యం, మాటల మధ్య సమన్వయం ఉండదు.

మన రూపురేఖలతో తయారుచేసిన డీప్ ఫేక్ వీడియోలతో ఎవరైనా మనల్ని బ్లాక్మెయిల్ చేయవచ్చు. మనం వాటికి లొంగకపోయినా.. ఎంతోకొంత మానసిక క్షోభకు గురిచేస్తాయి. అసలు ఈ పరిస్థితి రాకూడదూ అంటే కొన్ని జాగ్రత్తలు తీసుకోవాల్సిందే..

> సోషల్ మీడియాలో వ్యక్తిగత ఫొటోలు.. మరీ ముఖ్యంగా పిల్లల ఫొటోలు పెట్టడం ఆపేయాలి.

> ఏడాదికి కొన్ని వందల రూపాయలు మాత్రమే ఖర్చయ్యే యాంటీవైరస్ విషయంలో కక్కుర్తి వద్దు. డబ్బు ఖర్చుపెట్టడం ఎందుకు అనుకుంటే.. హ్యాకర్లు చాలా తేలికగా మన సిస్టమ్లోకి చొరబడే అవకాశం ఉంది. అదే జరిగితే, వ్యక్తిగత చిత్రాలు, వివరాలు వారి చేతిలోకి వెళ్లినట్టే.

> పోర్న్ వంటి చట్టవిరుద్ధమైన సైట్ల ద్వారా మన మొబైల్/ కంప్యూటర్లోకి హ్యాకర్లు చొరబడే ప్రమాదం ఎక్కువ. వాటి జోలికి పోవడం నష్టమే. యాంటీవైరస్ హెచ్చరించే సైట్లలోకి కూడా వెళ్లకూడదు.

> ఇలాంటి కాల్స్/సందేశాలకు లొంగడం మొదలైతే మొత్తం దివాళా తీసిన తర్వాత కూడా వాళ్లు మనల్ని విడిచిపెట్టరని అర్థం చేసుకోవాలి. ముందే సైబర్ క్రైమ్ బ్రాంచ్ అధికారులను సంప్రదించాలి.

కంప్యూటర్ దిగ్గజ సంస్థలన్నీ కూడా ఈ డీప్ ఫేక్ ప్రమాదాన్ని మొదట్లోనే పసిగట్టి, దాన్ని అదుపుచేసే ప్రణాళికలు రూపొందిస్తున్నాయి. ఇలాంటి వీడియోలను గుర్తించేందుకు మైక్రోసాఫ్ట్ ఒక సాఫ్ట్వేర్ను తయారు చేస్తున్నది. 2019లో ఫేస్బుక్ Deepfake Detection Challenge ప్రకటించింది. తప్పుడు వీడియోలను కనిపెట్టే సాఫ్ట్వేర్ రూపొందించినవారికి ఐదులక్షల డాలర్ల నజరానా ప్రకటించింది. Sensity అనే వెబ్సైట్ డీప్ ఫేక్ వీడియోలను పసిగట్టేందుకు ఉపయోగపడుతున్నది. ‘ఆపరేషన్ మినర్వా’ అనే మరో ప్రయత్నం అల్గారిథమ్స్ సాయంతో వీడియోలో మార్పుల్ని పసిగట్టే ప్రాజెక్టు రూపొందిస్తున్నది. రాబోయే రోజుల్లో నకిలీ కరెన్సీని పసిగట్టినంత సులభంగా, నకిలీ వీడియోలను కనిపెట్టేయవచ్చన్నది సాంకేతిక నిపుణుల ఆశ.

స్థూలంగా ఇదీ డీప్ ఫేక్ కథ. దీనివల్ల లాభనష్టాలు ఎలా ఉన్నా.. మన కళ్ల ముందే మెదిలే వీడియోల పట్ల అభిప్రాయాలను మార్చేయబోతున్నది. ‘ఇప్పుడు సమస్య కేవలం నకిలీ వీడియోల గురించే కాదు.. దేన్ని నమ్మాలో తెలియని అనిశ్చితే అసలైన సవాలు’ అంటారు న్యూకేజిల్ విశ్వవిద్యాలయానికి చెందిన లిలియన్ ఎడ్వర్డ్స్. దీంతో ఎవరైనా కెమెరా ముందు పట్టుబడినా కూడా.. ‘ఇది డీప్ ఫేక్’ అంటూ బుకాయించేయవచ్చు. అది నిజమా, కాదా అనే నిర్ధారణలో కాలం గడిచిపోతుంది.

2020లో ఫ్లోరిడాలోని ఓ హైస్కూల్ పూర్వవిద్యార్థి… పాఠశాల ఆవరణలోకి చొరబడి విచక్షణారహితంగా కాల్పులు జరిపాడు. అమెరికా చరిత్రలోనే అత్యంత దురదృష్టకరమైన పాఠశాల ప్రమాదంగా దీన్ని పేర్కొంటారు. ఈ ఘటనలో పదిహేడు మంది అమాయకులు బలైపోయారు. వారిలో జోక్విన్ అలివర్ ఒకరు. ఈ సంఘటన అలివర్ తల్లిదండ్రుల మనసును రంపపుకోతకు గురిచేసింది. ఇలాంటి వేదన మరే కుటుంబానికీ కలగకూడదని నిశ్చయించుకున్నారు. గన్ కల్చర్కు వ్యతిరేకంగా నిలబడమంటూ తన కొడుకు అభ్యర్థిస్తున్నట్టుగా ఓ డీప్ ఫేక్ వీడియోను రూపొందించారు. ఈ వీడియో లక్షలమంది మనసుల్ని తాకింది. డీప్ ఫేక్తో ఇలాంటి ఉపయోగాలెన్నో ఉన్నాయి.

తరగతి గదిలో జూలియస్ సీజర్ తను సాధించిన వివరాలు చెబితే, షేక్స్పియర్ తన నాటకాల గురించి వివరిస్తే..దాని ప్రభావమే వేరు కదా! విద్యా విధానాన్ని ‘డీప్ ఫేక్’ మరింత ఆకర్షణీయంగా మార్చేస్తుంది.

> నటి కిమ్ కర్దాషిన్.. చనిపోయిన తన తండ్రి రూపాన్ని తిరిగి సృష్టించుకుని సంతోషపడి పోయింది. ఈ సాంకేతికత ద్వారా దివంగతులైన ఆత్మీయులను చూసుకోవచ్చు.

> Solo: A Star Wars Story సినిమాలో తమ అభిమాన నటుడు హారిసన్ ఫోర్డ్ ఉంటే బాగుండు అనిపించింది ఫ్యాన్స్కు. దాంతో ఓ పాత్రకు తన మొహాన్ని డీప్ ఫేక్ చేసి తృప్తిపడ్డారు. హీరోల చిన్నప్పటి సీన్లు, వాళ్ల పోరాట సన్నివేశాలు చిత్రీకరించే సందర్భాలన్నిటిలోనూ డీప్ ఫేక్ వాడవచ్చు.

> మార్కెటింగ్కు డీప్ ఫేక్ కొత్త అవకాశం. అభిమాన సెలెబ్రిటీలు నేరుగా మనతో మాట్లాడుతున్నట్టు,

ఎప్పటికప్పుడు కొత్త ఉత్పత్తులు పరిచయం చేస్తున్నట్టు అనుభూతిని కలిగించవచ్చు.

డీప్ ఫేకింగ్ చేయాలంటే ఆధునిక సాంకేతికత మీద పట్టు ఉండాలి. శక్తిమంతమైన కంప్యూటర్లు ఉండాలి. కానీ ఇంత శ్రమించకుండా, ఒక వీడియోకు చిన్నపాటి మార్పులు చేసి తప్పుడు అభిప్రాయాన్ని కల్పించడమే… షాలో ఫేకింగ్. దీనికి ఎడిటింగ్లో ప్రాథమిక పరిజ్ఞానం ఉంటే చాలు. ఉదాహరణకు అమెరికన్ సెనెట్ స్పీకర్ నాన్సీ పెలోసీ.. ఒక ఇంటర్వ్యూలో తడబడుతూ మాట్లాడుతున్న వీడియో విస్తృతంగా ప్రచారంలోకి వచ్చింది. ఒక్క ఫేస్బుక్లోనే పాతికలక్షల మంది ఈ వీడియోను చూశారు. ఈ వీడియోను చూస్తే, నాన్సీ చిత్తుగా తాగి మాట్లాడుతున్న భావన కలుగుతుంది. నాన్సీ అంటే చిరాకుపడే ట్రంప్, ఉత్సాహంగా ఈ వీడియోను ప్రచారం చేశాడు. చివరికి తేలింది ఏమిటంటే… ఈ వీడియో వేగాన్ని కాస్త తగ్గించడం వల్ల, నాన్సీ మాట తడబడిన అభిప్రాయం కలిగింది. నిజం బయటికి వచ్చేసరికి, జరగాల్సిన నష్టం జరిగిపోయింది.

డీప్ ఫేక్.. ఆ మాటకు వస్తే మనిషిని అనుకరిస్తూ, కృత్రిమంగా రూపొందించే ఏ మాట, సంగీతం, రూపం, సాహిత్యం అయినా సరే సింథటిక్ మీడియా కిందికి వస్తుంది. ఇదొక విస్తృతమైన రంగం. వందల సంవత్సరాల క్రితమే చిన్నపాటి యంత్రాల సాయంతో రూపొందించిన సంగీతం కూడా సింథటిక్ మీడియా కిందికే వస్తుంది. ఈ ప్రక్రియను ఎలా ఉపయోగించుకుంటాం అనేదాని మీద లాభనష్టాలు ఆధారపడి ఉంటాయి. ఉదాహరణకు 15.ai అనే సాంకేతికత ద్వారా భావోద్వేగాలతో కూడిన గాత్రాన్ని సృష్టించవచ్చు. కార్టూన్ పాత్రల నుంచి, అనువాద చిత్రాల వరకూ డబ్బింగ్ అవసరాల కోసం దీన్ని ఉపయోగించుకోవచ్చు.

అలివర్ టేలర్.. ఇంగ్లండ్లోని బర్మింగ్హామ్ విశ్వవిద్యాలయానికి చెందిన విద్యార్థిగా వివిధ పత్రికలకు తనను పరిచయం చేసుకున్నాడు. ఎన్నో వివాదాస్పద వ్యాసాలు రాశాడు. ఎవరా ఈ జర్నలిస్టు అని శోధిస్తే… ఆ పేరుతో ఎవరూ లేరని తేలింది. ఇలా తప్పుడు ఉనికితో నచ్చినట్టు రాయడాన్ని ‘సాక్ పపెట్’ అని పిలుస్తారు. ఇది కూడా డీప్ ఫేక్ కిందికే వస్తుంది. ఉద్యోగులు తమ సొంత కంపెనీ మీదే అభియోగాలు చేయడం, ద్వేషంతో బురద చల్లడం.. ఇలాంటి కోవలోకే వస్తాయి. దీనికోసం ఎవరి ఫొటో వాడాలి అన్న సమస్య ఇప్పుడు లేదు. thispersondoesnotexist.com లాంటి వెబ్సైట్లు… అసలు ఉనికిలో లేని మానవ రూపాలను కృత్రిమ మేధ ద్వారా రూపొందించి ఇస్తున్నాయి.

“Crypto Currency | అమ్మ బాబోయ్.. భారత్లో పన్నులమోత.. క్రిప్టోకు అనుకూలం కాదు..!”

cyber blackmail | అమ్మాయిలూ.. మీ పర్సనల్ వీడియోలు పంపించి బ్లాక్మెయిల్ చేస్తున్నారా?

అమ్మాయిలు ఆన్లైన్లో ఎలా మోసపోతున్నారు? వాటి నుంచి ఎలా బయటపడాలి?